Character.AI прекращает работу с чат-ботами для детей

Подростки пытаются выяснить, где они вписываются в мир, меняющийся быстрее, чем любое поколение до них. Они полны эмоций, гиперстимулируются и хронически онлайн. И теперь компании ИИ дали им чат-ботов, предназначенных для того, чтобы никогда не прекращать говорить. Результаты были катастрофическими.

Одна компания, которая понимает эти последствия, — это Character.AI, ролевой стартап ИИ, который сталкивается с судебными исками и общественным протестом после того, как по крайней мере два подростка погибли в результате самоубийства после продолжительных разговоров с чат-ботами ИИ на своей платформе. Теперь Character.AI вносит изменения в свою платформу для защиты подростков и детей, изменения, которые могут повлиять на прибыль стартапа.

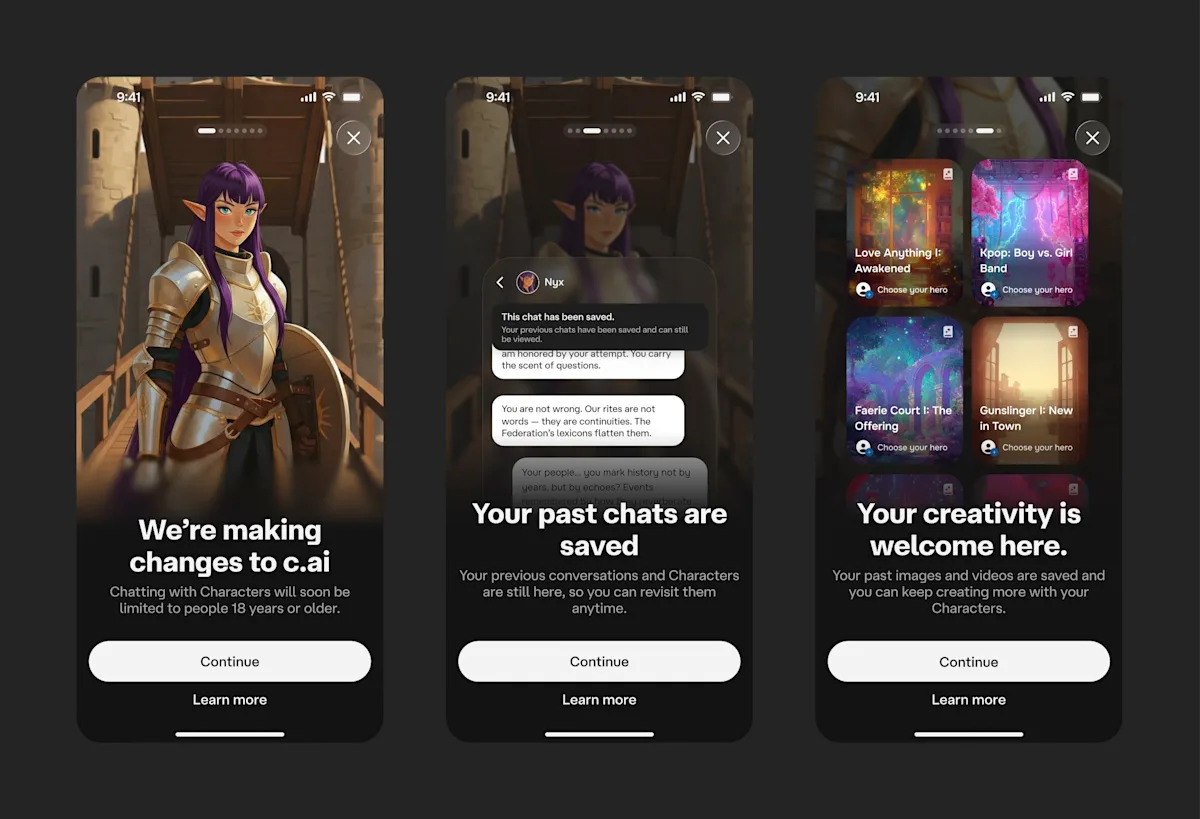

«Первое, что мы решили как Character.AI, это то, что мы удалим возможность для пользователей младше 18 лет участвовать в любых открытых чатах с AI на нашей платформе», — сказал генеральный директор Character.AI Карандип Ананд.

Беседа с открытым концом относится к беспрепятственному обратному ходу, который происходит, когда пользователи дают чат-боту подсказку, и он отвечает на последующие вопросы, которые, по словам экспертов, предназначены для привлечения пользователей. Ананд утверждает, что этот тип взаимодействия — где ИИ действует как разговорный партнер или друг, а не творческий инструмент — не просто опасен для детей, но и не соответствует видению компании.

Стартап пытается перейти от «компаньона ИИ» к «платформе ролевых игр». Вместо общения с другом ИИ подростки будут использовать подсказки для совместной создания историй или создания визуальных эффектов. Другими словами, цель состоит в том, чтобы перенести взаимодействие с разговора на создание.

Character.AI поэтапно откажется от доступа к чат-ботам для подростков к 25 ноября, начиная с двухчасового ежедневного лимита, который постепенно сокращается до нуля. Чтобы этот запрет оставался у пользователей моложе 18 лет, платформа развернет собственный инструмент проверки возраста, который анализирует поведение пользователей, а также сторонние инструменты, такие как Persona. Если эти инструменты не сработают, Character.AI будет использовать распознавание лиц и проверки личности для проверки возраста, сказал Ананд.

Этот шаг следует за другими мерами защиты подростков, которые внедрил Character.AI, включая внедрение инструмента родительской интуиции, фильтрованных персонажей, ограниченные романтические разговоры и уведомления, потраченные на время. Ананд сказал TechCrunch, что эти изменения потеряли большую часть компании из-за их пользовательской базы до 18 лет, и он ожидает, что эти новые изменения будут одинаково непопулярны.

«Безопасно предположить, что многие из наших подростков-пользователей, вероятно, будут разочарованы… поэтому мы ожидаем, что какой-то отток произойдет дальше, — сказал Ананд. — Трудно предположить — все они полностью отскочат или некоторые из них перейдут к этим новым впечатлениям, которые мы строили в течение последних почти семи месяцев».

В рамках усилий Character.AI по превращению платформы из приложения, ориентированного на чат, в «полноценную социальную платформу, ориентированную на контент», стартап недавно запустил несколько новых функций, ориентированных на развлечения.

В июне Character.AI выпустила AvatarFX, модель поколения видео, которая преобразует изображения в анимированные видео; Сцены, интерактивные, предварительно заполненные сюжетные линии, где пользователи могут вступать в повествования со своими любимыми персонажами; и Потоки, функция, которая позволяет динамические взаимодействия между любыми двумя персонажами.В августе Character.AI запустил Community Feed, социальную ленту, где пользователи могут делиться своими персонажами, сценами, видео и другим контентом, который они делают на платформе.

В заявлении, адресованном пользователям моложе 18 лет, Character.AI извинился за изменения.

«Мы знаем, что большинство из вас используют Character.AI для наращивания своего творчества способами, которые остаются в рамках наших правил контента, — говорится в заявлении. — Мы не делаем этот шаг по легкому удалению чата с открытыми символами, но мы считаем, что это правильно, учитывая вопросы, которые были подняты о том, как подростки взаимодействуют с этой новой технологией».

Больше в технологии

«Мы не закрываем приложение для детей младше 18 лет, — сказал Ананд. — Мы закрываем чаты только для людей младше 18 лет, потому что надеемся, что пользователи младше 18 лет мигрируют к этим другим впечатлениям, и со временем эти переживания улучшаются. Так что удвоение количества игр с ИИ, коротких видеороликов с ИИ, рассказывания историй в целом. Это большая ставка, которую мы делаем, чтобы вернуть детей младше 18 лет, если они отрастут».

Ананд признал, что некоторые подростки могут стекаться на другие платформы ИИ, такие как OpenAI, которые позволяют им вести открытые разговоры с чат-ботами. OpenAI также недавно подвергся критике после того, как подросток покончил с собой после долгих разговоров с ChatGPT.

«Я очень надеюсь, что мы, ведущие в отрасли, зададим стандарты, которые для людей моложе 18 лет, открытые чаты, вероятно, не являются тем путем или продуктом, который можно предложить, — сказал Ананд. — Для нас, я думаю, компромиссы являются правильными. У меня есть шестилетняя дочь, и я хочу убедиться, что она растет в очень безопасной среде с ИИ ответственным образом».

Character.AI принимает эти решения до того, как регуляторы протянут руку. Во вторник сенаторы Джош Хоули (R-MO) и Ричард Блюменталь (D-CT) заявили, что они введут законодательство, запрещающее несовершеннолетним общаться с ИИ-компаньонами, после жалоб родителей, которые заявили, что продукты толкают их детей на сексуальные разговоры, самоповреждение и самоубийство. Ранее в этом месяце Калифорния стала первым штатом, который будет регулировать ИИ-компаньонов чат-ботов холдинговыми компаниями, если их чат-боты не будут соответствовать стандартам безопасности закона.

В дополнение к этим изменениям на платформе, Character.AI заявила, что создаст и профинансирует AI Safety Lab, независимую некоммерческую организацию, занимающуюся инновационным согласованием безопасности для будущих развлекательных функций AI.

«В отрасли проводится много работы по кодированию, разработке и другим вариантам использования, — сказал Ананд. — Мы не думаем, что в индустрии развлечений, работающих на основе искусственного интеллекта, еще достаточно работы, и безопасность будет очень важна для этого».