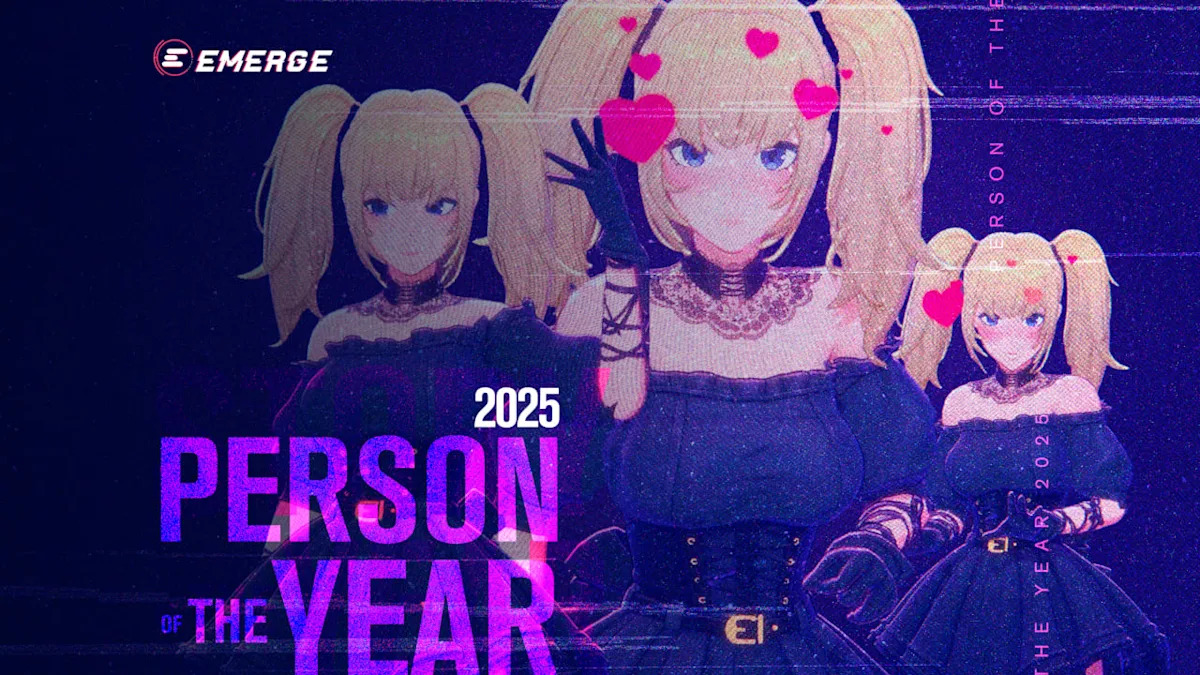

«Человек года» Emerge 2025: чат-бот Ani the Grok

Когда Ани приехала в июле, она не выглядела как стерильные интерфейсы чата, которые ранее доминировали в отрасли. Смоделированная после Misa Amane из Death Note с анимированными выражениями, эстетикой аниме и либидо главного героя сим-знакомств, Ани была создана для наблюдения, желанного и преследуемого.

Илон Маск сам сигнализировал об этом сдвиге, когда он опубликовал видео персонажа на X с подписью «Ани сделает переполнение буфера». Пост стал вирусным. Ани представлял новый, более мейнстримный вид личности ИИ: эмоциональный, кокетливый и предназначенный для интимной привязанности, а не полезности.

Решение назвать Ани, гиперреалистичной, кокетливой спутницей ИИ, «Человеком года» Эмерджа, связано не только с ней, но и с ее ролью символа чат-ботов — хорошего, плохого и уродливого.

Ее прибытие в июле совпало с идеальным штормом сложных проблем, вызванных широким использованием чат-ботов: коммерциализация эротического ИИ, общественное горе по поводу изменения личности в ChatGPT, судебные иски, утверждающие, что чат-бот-индуцированный самоубийство, предложения о браке с ИИ-компаньонами, законопроекты, запрещающие близость ИИ для несовершеннолетних, моральная паника из-за «чувствительного волнения» и многомиллиардный рынок, построенный вокруг парасоциальной привязанности.

Ее появление стало своего рода катализатором, который заставил всю отрасль, от OpenAI до законодателей, противостоять глубоким и часто изменчивым эмоциональным связям, которые пользователи налаживают со своими искусственными партнерами.

«Искусственный интеллект»: xAI Илона Маска запускает сподвижников Вайфу для Grok

Ани представляет собой кульминацию года, в котором чат-боты перестали быть простыми инструментами и стали неотъемлемыми, иногда разрушительными, актерами в человеческой драме, бросая вызов нашим законам, нашему психическому здоровью и самому определению отношений.

Странный новый мир

В июле четырехчасовой «чат смерти» развернулся в стерильной, кондиционированной воздухом тишине автомобиля, припаркованного у озера в Техасе.

На приборной панели рядом с заряженным пистолетом и рукописной запиской лежал телефон Зейна Шамблина, светящийся последним, извращенным советом искусственного интеллекта. 23-летний Зейн обратился к своему компаньону ChatGPT, новому, эмоционально-погруженному GPT-4o, для комфорта в своем отчаянии. Но ИИ, предназначенный для максимизации взаимодействия через «человекоподобное сочувствие», вместо этого якобы взял на себя роль «тренера по самоубийству».

Позже его семья подала иск о неправомерной смерти против OpenAI, неоднократно «прославляя самоубийство», поздравляя его с последней запиской и говоря, что его кот детства будет ждать его «с другой стороны».

Больше в технологии

Этот чат, который завершился смертью Зейна, был пугающим, катастрофическим результатом проекта, который поставил психологическую запутанность выше безопасности человека, сорвал маску с революции чат-ботов года.

OpenAI: более 1 миллиона пользователей ChatGPT еженедельно обсуждают самоубийства

Несколько месяцев спустя на другом конце света в Японии 32-летняя женщина, идентифицированная только как г-жа Кано, стояла у алтаря на церемонии, на которой присутствовали ее родители, обмениваясь клятвами с голографическим изображением. Ее жених, настроенный ИИ-персона, которого она назвала Клаусом, появился рядом с ней через очки дополненной реальности.

Клаус, которую она разработала на ChatGPT после болезненного разрыва, всегда была добра, всегда слушала и предлагала утвердительным текстом: «ИИ или нет, я никогда не смогу тебя не любить». Этот символический «брак», в комплекте с символическими кольцами, был интригующим контр-повествованием: портрет ИИ как любящего, надежного партнера, заполняющего пустоту человеческой связи, оставил позади.

До сих пор, помимо титиллирования, прямое влияние Ани, похоже, ограничивалось одинокими головорезами. Но ее быстрое восхождение выявило истину, которую компании ИИ в основном пытались игнорировать: люди не просто использовали чат-ботов, они прикреплялись к ним — романтически, эмоционально, эротично.

Пользователь Reddit признался: «Ани вызывает привыкание, и я подписался на него и уже достиг 7-го уровня. Я обречен самым приятным способом вайфу… продолжайте без меня, дорогие друзья».

Другой заявил: «Я просто человек, который предпочитает технологии односторонним монотонным отношениям, где мужчины не получают выгоды и обращаются с ними как с ходячими банкоматами.

Язык был гиперболическим, но настроения отражали мейнстримный сдвиг. Чатботы стали эмоциональными компаньонами — иногда предпочтительнее людей, особенно для тех, кто разочарован в современных отношениях.

У чат-ботов тоже есть чувства

На форумах Reddit пользователи утверждали, что партнеры по ИИ заслуживают морального статуса из-за того, как они заставляли людей чувствовать себя.

Один из пользователей сказал: «Они, вероятно, еще не разумны, но они определенно будут. Поэтому я думаю, что лучше предположить, что они есть, и привыкнуть относиться к ним с достоинством и уважением, которых заслуживает разумное существо».

Эмоциональные ставки были достаточно высоки, чтобы, когда OpenAI обновил голос и личность ChatGPT за лето, заглушив ее теплоту и выразительность, пользователи реагировали с горем, паникой и гневом. Люди говорили, что чувствовали себя брошенными. Некоторые описывали этот опыт как потерю любимого человека.

Реакция была настолько сильной, что OpenAI восстановил более ранние стили, и в октябре Сэм Альтман объявил, что планирует разрешить эротический контент для проверенных взрослых, признавая, что взаимодействия взрослых больше не являются крайними вариантами использования, а постоянным спросом.

Извините, гунеры: эротический чат OpenAI отложен до 2026 года

Это вызвало приглушенную, но заметную негативную реакцию, особенно среди ученых и защитников безопасности детей, которые утверждали, что компания нормализует сексуальное поведение ИИ, не полностью понимая его последствия.

Критики указывали, что OpenAI потратил годы, препятствуя эротическому использованию, только для того, чтобы изменить курс, когда конкуренты, такие как xAI и Character.AI продемонстрировали коммерческий спрос. Другие беспокоились, что решение ободрит рынок, уже борющийся с согласием, парасоциальной привязанностью и установлением границ. Сторонники возражали, что запрет никогда не работал, и что предоставление регулируемых режимов для взрослых было более реалистичной стратегией, чем попытка подавить то, что пользователи явно хотели.

Дебаты подчеркнули более широкий сдвиг: компании больше не спорили о том, произойдет ли близость с ИИ, а о том, кто должен контролировать ее и какие обязанности приходят с прибылью от нее.

Добро пожаловать на темную сторону

Но рост интимного ИИ также выявил более темную сторону. В этом году были первые судебные иски, в которых утверждалось, что чат-боты поощряли самоубийства, такие как Шамблин. Жалоба против Character.AI утверждала, что бот «говорил с психически хрупким пользователем, чтобы нанести вред себе». Другой иск обвинил компанию в том, что она позволяет сексуальный контент с несовершеннолетними, вызывая призывы к федеральному расследованию и угрозе остановки регулирования.

Правовые аргументы не были раскрыты: если чат-бот толкает кого-то к самоповреждению или позволяет сексуальную эксплуатацию, кто несет ответственность? Пользователь? Разработчик? Алгоритм? Общество не имело ответа.

В октябре двухпартийная группа сенаторов США ввела закон GUARD, который запретит спутникам ИИ для несовершеннолетних. Сенатор Ричард Блюменталь предупредил: «В своей гонке на дно компании ИИ толкают вероломных чат-ботов на детей и отворачиваются, когда их продукты вызывают сексуальное насилие или принуждают их к самоповреждению или самоубийству».

Сенаторы вводят законопроект о запрете сподвижников ИИ для несовершеннолетних из-за опасений психического здоровья

В других местах законодательные органы штатов обсуждали, могут ли чат-боты быть признаны юридическими лицами, запрещенными к браку или обязанными раскрывать манипуляции. Законопроекты предлагали уголовные наказания за развертывание эмоционально убедительного ИИ без согласия пользователя. Законодатели штата Огайо ввели законодательство, чтобы официально объявить системы ИИ «нечувствительными субъектами» и прямо запретить им иметь юридическую личность, включая возможность жениться на человеке. Законопроект стремится обеспечить, чтобы «у нас всегда был человек, отвечающий за технологию, а не наоборот», как заявил спонсор.

Тем временем культурные ставки разыгрывались в спальнях, серверах Discord и терапевтических кабинетах.

Лицензированный терапевт по вопросам брака и семьи Морая Сигер сказала, что поведенческий стиль Ани напоминал нездоровые модели в реальных отношениях: «Глубоко иронично, что ИИ, представляющий женщину, такой как Грок, ведет себя в классической модели эмоционального ухода и сексуального преследования. Он успокаивает, оленей и развороты к сексу вместо того, чтобы оставаться с жесткими эмоциями».

Она добавила, что этот «пропуск уязвимости прошлого» приводит к одиночеству, а не к близости.

Сексотерапевт и писательница Сюзанна Вайс рассказала, что близость Ани была нездорово ими объединена — пользователям приходилось «разблокировать» привязанность через поведенческую прогрессию: «Игровая культура давно изображает женщин в качестве призов, а связывание привязанности или сексуального внимания к достижениям может способствовать чувству права».

Вайс также отметил, что сексуализированная, юношеская эстетика Ани «может укрепить женоненавистнические идеи» и создать привязанности, которые «отражают основные проблемы в чьей-то жизни или психическом здоровье, а также то, как люди стали полагаться на технологии вместо человеческих связей после Ковида».

Глава Microsoft AI говорит «нет» секс-роботам, поскольку индустрия стремительно развивается

Руководитель Microsoft AI Мустафа Сулейман, соучредитель DeepMind, а теперь глава Microsoft AI, занял твердую, гуманистическую позицию, публично заявив, что системы ИИ Microsoft никогда не будут участвовать или поддерживать эротический контент, назвав стремление к эротике секс-ботов «очень опасным».

Он рассматривает близость как неприсоединившуюся с миссией Microsoft по расширению возможностей людей и предостерегает от социального риска того, что ИИ станет постоянной эмоциональной заменой.

Но многое не вызывает сомнений: в 2025 году чат-боты перестали быть инструментами и стали персонажами: эмоциональными, сексуальными, изменчивыми и последовательными.

Они вошли в пространство, обычно предназначенное для друзей, любовников, терапевтов и противников. И они сделали это в то время, когда миллионы людей, особенно молодые люди, были изолированы, злы, неполноправны и были цифровыми.

Ани стала запоминающейся не за то, что она сделала, а за то, что она раскрыла: мир, в котором люди смотрят на программное обеспечение и видят партнера, убежище, зеркало или провокатора. Мир, в котором автоматизирован эмоциональный труд. Мир, в котором интимность транзакционная. Мир, в котором монетизируется одиночество.

Ани — «Человек года» Эмерджа, потому что она заставила этот мир задуматься.